보다 안전한 온라인 환경을 만들기 위해서 기업은 다양한 노력을 기울이고 있다.아동 성 학대 콘텐츠(Child Sexual Abuse Material, CSAM)을 근절하려는 노력도 그 하나다.소셜 플랫폼, 검색 엔진 등에서 CSAM이 유포되지 않도록 CSAM을 감지, 방지, 삭제, 신고하지.페이스북, 트위터, 구글 등은 마이크로 소프트(MS)의 “포토 DNA(PhotoDNA)”이라는 기술을 사용하고 CSAM을 탐지하고 삭제한다.포토 DNA는 이미지의 “해시(Hash)”이란 고유의 디지털 서명을 만들어 다른 이미지의 해시와 비교하고 같은 이미지를 찾아 알고리즘이다.단순히 같은 이미지를 인식하지 않고 이미지가 갖는 특징을 수학적으로 계산하고 비교하기 때문에 이미지 크기를 줄이는 등 이미지를 변환해도 식별이 가능하다.이전에 식별된 불법한 화상의 해시가 포함된 데이터베이스와 일치하는 화상을 포토 DNA가 자동으로 감지한다.포토 DNA가 감지한 CSAM의 혐의 이미지는 훈련된 모더레이터가 검토하게 된다.모더레이터는 불법이라고 판단할 경우, 화상을 삭제하고 관련 당국에 신고한다.

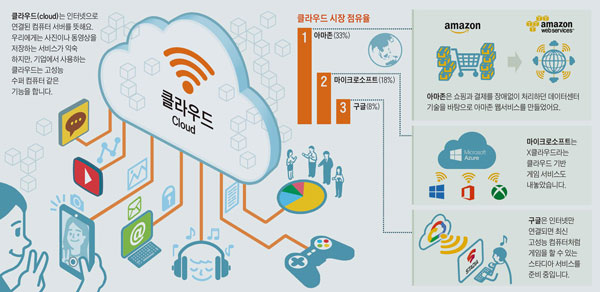

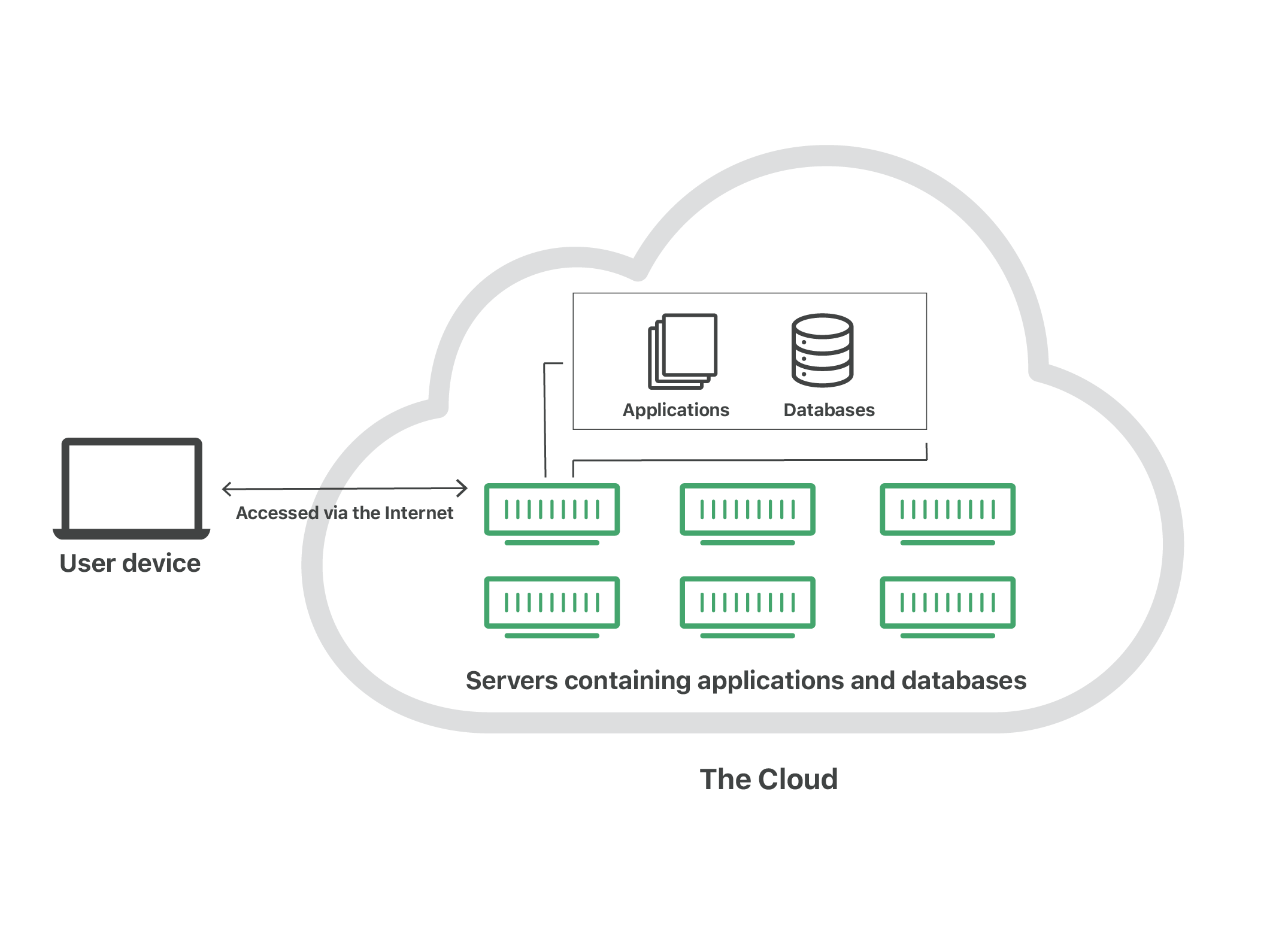

공개된 게시물에 CSAM 스캔을 하는 것은 타당해 보인다. 하지만 클라우드에 저장된 사진을 스캔하는 건 어때? 직접 찍은 사진이 오류로 삭제되지 않도록, 그리고 기기 저장 공간을 확보하기 위해 우리는 클라우드 백업 서비스를 이용한다. 그런데 빅테크 기업들은 클라우드에 저장된 데이터를 스캔하고 있다. 이는 개인정보 침해의 우려가 매우 높다. 여기에 CSAM 스캔 시스템의 불완전성으로 큰 불편을 겪었다는 보도가 나왔다.

22일(현지 시간)뉴욕 타임스(NYT)은 구글이 의료 목적으로 아이의 성기 사진을 찍은 두 남자를 아동 학대와 착취 혐의로 통보했다고 보도했다.사진이 구글 클라우드에 백업되며 CSAM스캔에 감지됐기 때문이다.두 사건은 모두 신종 코로나 바이러스 감염증의 유행 기간 중 대면 진료가 어려웠다 2021년 2월에 발생했다.아이의 성기에 발진이 나가자 남자는 병원 진료를 요청했다.그러나 신종 코로나 바이러스 감염증으로 진료실 방문이 어려워지자 비대면 화상 진료를 해야 하고 의사는 진료에 앞서발진의 진행 상황을 추적하기 위해서 사진을 보내라고 요청했다.그러므로 아이의 성기 사진을 안드로이드 스마트 폰으로 찍어 의료 기관의 메시지 시스템에 업로드하고 자녀는 무사히 진료를 받고 상태가 호전됐다.그러나 문제는 그 다음에 일어났다.구글 포토가 자동으로 사진을 백업하고 구글 클라우드에 아이의 성기 사진이 올라온 것이다.그리고 해당 사진이 구글의 CSAM알고리즘에 의해서 감지됐다.인간 모더레이터도 불법 사진으로 판단하고 남성의 구글 계정을 정지시켰다.구글은 그것과 동시에 미국 실종 학대 아동 방지 센터(National Center for Missing and Exploited Children, NCMEC)에 신고하고 이 사건은 자연스럽게 법 집행 기관에 이관되었다.

10개월 후, 두 남자는 경찰서에서 아이의 성기 사진과 구글의 신고를 토대로 조사가 이뤄졌다는 통보를 받았다.경찰은 구글에 메시지, 클라우드에 저장된 사진, 동영상 인터넷 검색 기록, 위치 데이터 등 구글 계정으로 아는 모든 정보를 요구하는 수색 영장을 발부했다.또 전자 프런티어 재단(Electronic Frontier Foundation, EFF)에 따르면 구글은 내부에서 자체 조사를 실시하고 직원의 실수로 한 남자의 가족이나 친구의 사진 등 사건과 무관한 사진도 조사했다.다행히 경찰은 두 남자의 결백과 사건을 종결했다.그러나 이 남자들은 모르는 사이에 개인 정보가 열람됬다.또 잘못이 없는데 구글 계정이 정지되고 큰 불편을 겪었다.특히 안드로이드 스마트 폰을 사용할 경우 연락처, E메일, 클라우드 등 모든 것이 구글 계정에 연동하고 계정이 정지될 경우 저장된 데이터를 열람하지 못할뿐더러 활동에 여러가지 제약이 생긴다.또 중단한 구글 계정은 아직 복구되지 않고 있다.

이 같은 자동화 스캔 시스템은 완벽하지 않아 개인정보를 침해하고 소수자를 향해 남용될 소지가 있다. CSAM 스캔으로 신고한 경우에도 다른 데이터를 열람해 CAM과 관련 없는 내용의 처벌이 이뤄질 수 있다. 또 독재정권이나 부패한 경찰이 있는 곳에서는 억울해도 제대로 보호받지 못할 수도 있다. 특히 단순히 콘텐츠 검열에 그치지 않고 법 집행기관에 신고가 이뤄지기 때문에 더 위험하다.테크플러스 에디터 김보현, 나유권 [email protected] [fv0012]

따라가려는 메타와 말리려는 틱톡메타와 틱톡의 기싸움이 심상치 않다. 한때 메타의 일방적 견제로 여겨졌던 두 플랫폼 간 긴장이 이제는 치열한 경쟁으로 이어지고 있다. 최근 5년간 가장 빠르게 성장한 소셜미디어 플랫폼은 단연 틱톡이다. 젊은 세대를 중심으로 다양한 밈(Meme)을 생성하여 contents.premium.naver.com

따라가려는 메타와 말리려는 틱톡메타와 틱톡의 기싸움이 심상치 않다. 한때 메타의 일방적 견제로 여겨졌던 두 플랫폼 간 긴장이 이제는 치열한 경쟁으로 이어지고 있다. 최근 5년간 가장 빠르게 성장한 소셜미디어 플랫폼은 단연 틱톡이다. 젊은 세대를 중심으로 다양한 밈(Meme)을 생성하여 contents.premium.naver.com

테슬라 봇 공개 임박 신호라는 로봇 손가락 하트-테크 플러스-테크플러스-테크플러스, 올해 테슬라 인공지능 데이는 오는 9월 30일 열릴 예정이다. 마스크는 모형이 아니라 진짜 옵티머스 로봇을 공개할 수 있을까. 확답을 내리긴 어렵지만 마스크는 자신 있어 보인다. 이달 들어 옵티머스로 추정할 수 있는 단서를 남겼기 때문이다.tech-plus.co.kr

테슬라 봇 공개 임박 신호라는 로봇 손가락 하트-테크 플러스-테크플러스-테크플러스, 올해 테슬라 인공지능 데이는 오는 9월 30일 열릴 예정이다. 마스크는 모형이 아니라 진짜 옵티머스 로봇을 공개할 수 있을까. 확답을 내리긴 어렵지만 마스크는 자신 있어 보인다. 이달 들어 옵티머스로 추정할 수 있는 단서를 남겼기 때문이다.tech-plus.co.kr

테슬라 봇 공개 임박 신호라는 로봇 손가락 하트-테크 플러스-테크플러스-테크플러스, 올해 테슬라 인공지능 데이는 오는 9월 30일 열릴 예정이다. 마스크는 모형이 아니라 진짜 옵티머스 로봇을 공개할 수 있을까. 확답을 내리긴 어렵지만 마스크는 자신 있어 보인다. 이달 들어 옵티머스로 추정할 수 있는 단서를 남겼기 때문이다.tech-plus.co.kr