- 테슬라 오토파일럿 리라이트(Autopilot Rewrite)

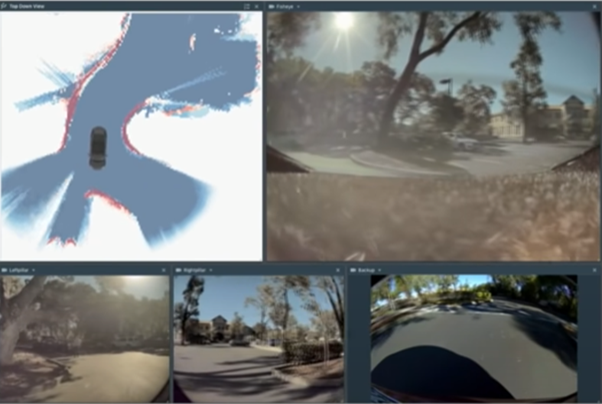

- – 테슬라의 AI for Full-Self Driving 강연에 따르면 기존에는 각 방향의 카메라가 대상을 찍을 때 Occupancy Tracker라는 기능이 2D 이미지를 하나로 통합하여 작은 지도 생성

- – 이는 개발자가 직접 손으로 코드를 짜는 방식의 소프트웨어 1.0(Software 1.0)으로 이 과정에서 많은 문제가 발생. 이하에 따라 자세히 설명

< 출처 : Matroid Youtube >

- 현재는 인공지능 신경망을 적극 활용하는 ‘소프트웨어 2.0(Software 2.0)’으로 구식 1.0을 점차 대체. 이러한 과정을 테슬라는 ‘오토 파일럿 리라이트(Autopilot Rewrite)’라고 표현하며,

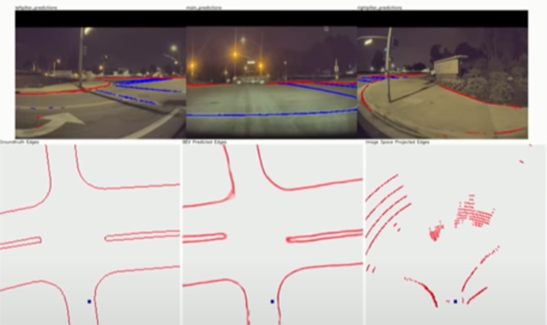

- – 아래 그림에서 왼쪽은 실제 지형, 중앙은 소프트웨어 2.0 신경망 기반, 오른쪽은 1.0 기반의 결과값으로 큰 성능 향상이 있음을 확인

- – 특히 ‘버드 아이뷰(Bird’s eye view)’ 신경망을 통해 3D(3차원)로 도로의 경계를 정확하게 검출할 뿐만 아니라 주행영역, 도로 진행방향 예측, 분리구간 확인 등 부가적인 정보도 함께 추출

< 출처 : Matroid Youtube >

2. 오토파일럿 리라이트 / 3D라벨링 / FSD 컴퓨터

- 꼬불꼬불한 길은 차선 끝이 메인 카메라 시각에서 벗어날 수 있고, 마찬가지로 신호등과 정지 표지판도 메인 카메라만으로는 모두 파악되지 않을 수 있다. 예를 들어 아래 화상에서 Fisheye(상단 오른쪽) 카메라는 차선을 예측하기에 충분한 시야를 갖고 있으나 메인 카메라(하단 오른쪽)는 곤란한 상황

- Left Pillar 카메라(상단 왼쪽)에서는 노란색 버스가 라벨링되어 추적이 가능하나 Fisheye(상단 오른쪽)에서는 동일한 버스임에도 불구하고 시야에 들어오지 않아 라벨이 제거되는 문제가 발생. 이렇게 되면 오토파일럿 입장에서는 어떤 결과치를 신뢰할지를 결정하지 못하고 오직 메인 카메라 정보만 선호하게 된다. 때때로 테슬라 자동운전을 이해할 수 없는 사고는 이에 기인한다고 생각된다.

<출처 : Reddit>

- 그만큼 메인 카메라가 가장 중요하기 때문에 아래 영상을 보면 메인 카메라는 모든 프레임을 업데이트하는 반면(영상이 매끄럽다), 다른 카메라는 4프레임에 한 번씩 업데이트되는 것을 알 수 있다(영상 끊김).

- 이는 컴퓨팅 파워(Computebudget)의 90%를 사용해 초당 99프레임을 처리할 수 있는 HW2(하드웨어2)에 자동 조종사가 적용되었기 때문.

- 하지만 지금은 이보다 21배나 뛰어난 FSD 컴퓨터를 활용해 차량에 설치된 8대의 카메라가 모두 초당 36프레임을 업데이트할 수 있고, 그래도 컴퓨팅 파워의 14%밖에 들지 않는다. 이는 메인 카메라뿐만 아니라 모든 카메라의 데이터를 동일한 수준으로 취급할 수 있다는 것을 의미한다.

- – 이로써 카메라별 신경망이 일부 프레임에 대해 개별적으로 결과값을 만들고 그 다음 그 값을 결합하여 처리하는 대신(아래 히드라넷 설명 참조) 한꺼번에 통합된 비전(시각)에 기초한 결과치를 만들어 낼 수 있다.

※ 테슬라 자율주행 신경망 HydraNet 설명1. 테슬라 AI Stack-테슬라는 전 세계적으로 약 100만대 판매된 테슬라 차량에서 데이터를… blog.naver.com

- 이런 과정이 바로 오토 파일럿의 리라이트. 종합하면, 리라이트 아키텍처는 탑재된 모든 카메라를 기반으로 하는 단일 경로 예측 헤드를 가지는 것이며, 아키텍처의 다른 많은 부분은 결합하고 단순화. 그리고 RNN과 같은 인공 지능 신경망이 인간의 손에 의한 전통적인 C++ 코드를 대체하여 FSD 컴퓨터와 같이 기존보다 업그레이드된 하드웨어가 이를 구현하는 일련의 과정

- – 진보된 오토 파일럿은 메인 카메라의 공백을 다른 카메라가 매끄럽게 메워 연결할 수 있어 향후 신호기나 정지표지판, 차선 인식 성능 개선뿐 아니라 그동안 문제가 됐던 정지 차량 인식 등도 해결할 수 있을 것으로 보인다.

3. 오토파일럿 리라이트 현황

- 미국의 업계 전문가들에 따르면 올해 8월부터 테슬라 차량에 Plaid Net이라 불리는 새로운 신경망이 탑재되기 시작했다. 아마도소프트웨어2.0과관련되어있을것으로추측

- – 엘론 머스크는 최근 트윗에서 데이터 라벨링을 포함한 꽤 많은 부분이 재개발된 (릴라이트) 상태이며, 이는 신경망 훈련(트레이닝)에서 추론에 이르는 모든 데이터 처리 과정이 기존의 2D를 넘어 3D를 다룰 것이라고 밝혔다.

- – 그리고 9월 22일 배터리데이 행사에서는 완전 자율주행 오토파일럿 베타 버전(Full Self Driving Autopilot Beta) 언급

- – 전체 오토 파일럿 소프트웨어 스택을 근본적으로 다시 작성. 기존에는 2D 단일 이미지 다발을 라벨링했다면 현재는 3D 비디오 영상에 라벨을 붙이는 방식으로 변화. 차량에 장착된 8대의 카메라가 수집한 전체 영상 세그먼트에 라벨을 붙여 시간에 따른 대상(Object)의 변화를 보다 정확하게 계산

- – 이를 통해 신경망의 정교함과 전반적인 로직이 획기적으로 개선되었으며, 베타 버전은 1개월 정도 후에 출시 예정

< 출처 : Youtube / 2020 Annu al Shareholder Meeting and Battery Day >

4) 시사점

- 이번 FSD 오토파일럿 베타를 통해 한 달 뒤 곧바로 레벨4 이상의 자율주행이 가능해지는 것은 아니다. 완전 자율주행이 가능하도록 하드웨어와 소프트웨어 기반 시스템을 모두 갖췄다는 뜻이니 진짜 성능이 나올지는 두고 봐야 한다.

- -요리도구를준비하고재료를다갖춰놓았다고그음식이완성되는것이아니라실제로맛있을수도있는것과같다. 물론경쟁사를압도하는수준의기술력이며완전자율주행시장을독식하는그림도그릴수있지만,그렇다고거의10년가까운먼미래를보고현재시가총액1.500조원이까운밸류를주기에는개인적으로과잉이라고생각합니다.

- – 이번 배터리 데이 내용도 사실 다른 자동차 OEM이 따라잡지 못할 정도로 배터리 기술이 잘 준비돼 있을 것으로 보이나 그동안 투자자들이 이를 뛰어넘는 과도한 기대감을 갖고 있어 주가가 오히려 하락.

- – 마찬가지로 자율주행에 대한 기대감도 상당히 큰 상황이지만 기반이 마련되면서 완전 자율주행을 거의 달성한 것처럼 과도하게 예상할 수 있는 부분. – 하지만 현재로서는 가장 앞선 1위 업체임은 자명한 사실.